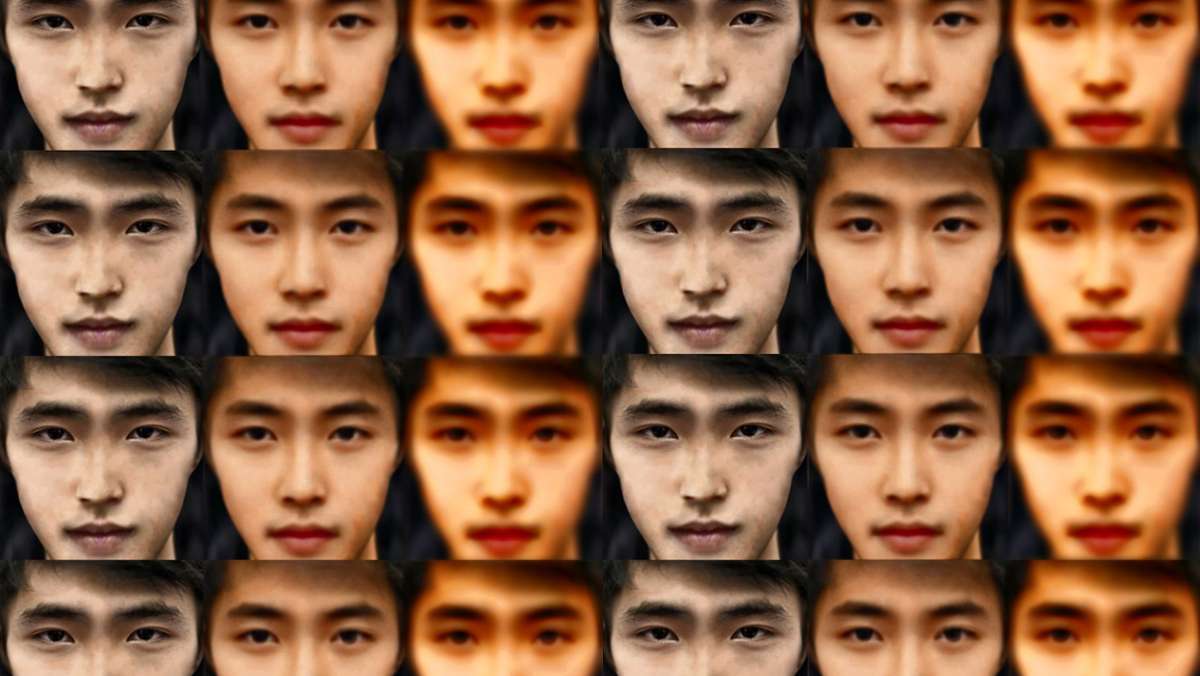

Justus Thies forscht im Tübinger Cyber Valley daran, wie Computer die Gesichtszüge eines Menschen auf einen anderen übertragen können. Ein Interview darüber, wie Künstliche Intelligenz unseren Alltag revolutionieren könnte.

18.05.2021 - 14:07 Uhr

Tübingen - Auf der Digitalmesse Republica geht es vom 20. Mai an um Facebook, Datenschutz und Cybersicherheit. Vor dem Auftakt der dreitägigen Veranstaltung spricht der Tübinger Forscher Justus Thies über Chancen und Risiken neuer Techniken.