Die Arbeitswissenschaftler des Stuttgarter Fraunhofer IAO haben einen Traum: Der Computer erkennt, wenn sein Benutzer müde und abgespannt ist, und reagiert darauf. Vorerst arbeiten sie daran, Emotionen überhaupt zu messen und einzuordnen.

Stuttgart - Nach einem harten Vormittag voller Präsentationen ist Antonia Maier müde. Die Elektrode an ihrem Kopf misst entsprechende Signale, ihr Computer weiß, was zu tun ist; schließlich kennt er seine Besitzerin schon lange. Er legt die Mails, die sich angehäuft haben, erst einmal im Hintergrund ab. Eingeblendet wird nur die Nachricht, in der ihr Chef sie lobt. Im Anschluss lässt er Antonia einen fast fertigen Vortrag bearbeiten. Am Text zu feilen, das weiß die Software, entspannt Antonia Maier, das macht ihr Spaß. Und schon ist wieder eine Aufgabe erledigt.

Noch ist so ein Szenario eine Zukunftsvision. Aber Forscher arbeiten an einem Computer, der sich seinem Besitzer anpasst und ihm gute Gefühle bei der Arbeit beschert. Dafür müssen allerdings noch einige Grundlagen geklärt werden: Wie kann man Emotionen möglichst genau messen? Was passiert im Gehirn, wenn Menschen technische Geräte benutzen? Dies erforschen Wissenschaftler eines neuen Labors am Fraunhofer Institut für Arbeitswirtschaft und Organisation (IAO) in Stuttgart.

Pionierarbeit im Neurolab

Ihr Neurolab ist eines der ersten seiner Art in Deutschland. Über die Messung von Hirnströmen wollen die Forscher genauer herausbekommen, welche Arbeitssituationen die Anwender auf welche Weise mental und emotional beschäftigt. Auf Grundlage dieser Kenntnisse sollen in Zukunft Mensch-Computer-Schnittstellen entwickelt werden, die Emotionen der Nutzer erkennen und sich entsprechend anpassen.

Ein erstes Projekt namens Emojo wird vom Bundesministerium für Bildung und Forschung gefördert. Die Forscher verstehen sich durchaus als Pioniere, zumindest in Deutschland: „Den Begriff Neuro-Ergonomics gibt es im Englischen schon länger, eine deutsche Entsprechung ist uns nicht bekannt“, sagt Kathrin Pollmann. „Neuro-Arbeitswissenschaft“ könne man sagen. „Wenn wir Mensch-Technik-Interaktion gestalten, kommen wir um den Begriff der User Experience nicht herum“, sagt Pollmann. Der englische Begriffe meint die Perspektive der Nutzer und deren Erfahrungen mit ihrer Arbeitsumgebung. Oder, wie Pollmann sagt: „Es geht nicht nur darum, gut arbeiten zu können, sondern auch um ein positives Erlebnis.“

Lange stellte die Frage, wie sich der Nutzer beim Arbeiten fühlt, eine Hürde für die Wissenschaft dar: „Subjektives Erleben konnte man nicht erfassen, ohne die Leute zu stören oder bei der Arbeit zu unterbrechen“, erklärt Pollmann. Auch das Gespräch nach der Arbeitssituation liefert möglicherweise falsche Ergebnisse, da die menschliche Erinnerung ungenau ist, Dinge im Nachhinein verherrlicht oder schlechter bewertet, oder manche Aspekte schlicht vergisst. Spannend für die Neuro-Arbeitswissenschaft sind aber die Erlebnisse, die Gefühle genau in dem Moment, in dem Menschen eine Aufgabe meistern.

Symbiose zwischen Mensch und Maschine

Die gegenwärtigen technischen Systeme sind kaum in der Lage, ihre Nutzer zu beobachten und daraus in Echtzeit Schlüsse zu ziehen. „Unser Ziel ist ein ko-adaptiver Lernprozess, in dem das System vom Menschen lernt und sich anpasst, eine Art Symbiose zwischen Mensch und Maschine“, sagt Pollmanns Kollege Mathias Vukelic. So genannte Brain-Computer-Interfaces – also Schnittstellen zwischen Gehirn und Computer – werden unter anderem in der Medizin eingesetzt: auf ihrer Grundlage können beispielsweise Querschnittsgelähmte lernen, mit Gedankenkraft über Neurofeedback ein sogenanntes Exo-Skelett zu bewegen. Auch wenn diese Technik noch nicht ausgereift ist, sind die Forscher optimistisch, mit ähnlichen Lösungen auch gesunden Menschen helfen zu können.

Der Gedanke ist nicht neu; schon seit vielen Jahren versuchen Forscher über Kontextinformationen herauszufinden, wie gut das Team aus Mensch und Maschine harmoniert. Dafür wird unter anderem die Leitfähigkeit der Haut gemessen; feuchte Haut ist ein Zeichen für Stress. Für Kathrin Pollmann ist das aber ein Umweg mit ungenauen Ergebnissen: „Wir wollen direkten Zugang zu den Emotionen.“

Die Software ärgert den Nutzer

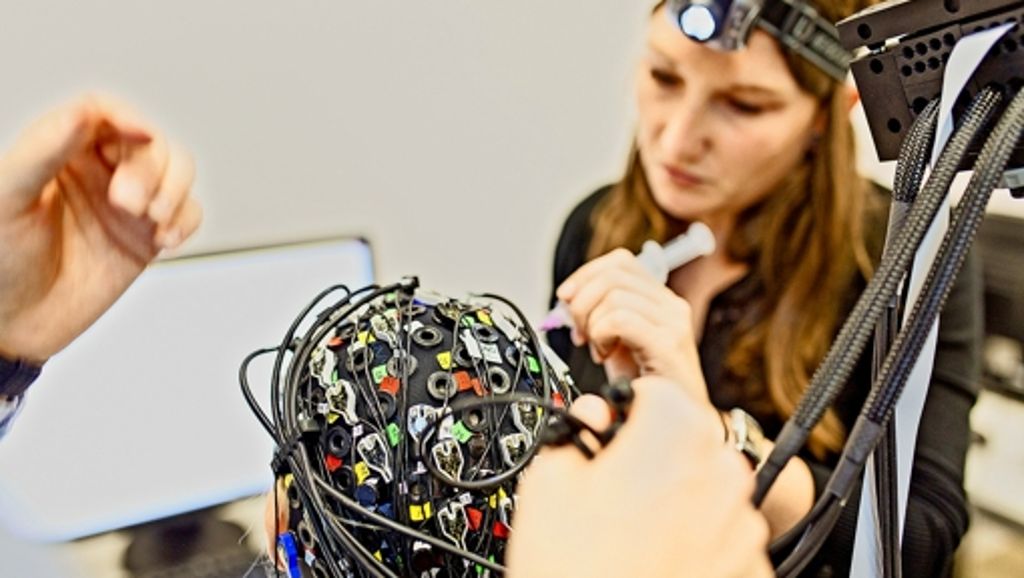

Ihre Probanden verkabeln die Forscher mit vielen Elektroden, die Hirnströme aufnehmen, auf der Kopfhaut. Zusätzlich wird mittels einer Nah-Infrarot-Spektroskopie der Sauerstoffgehalt im Blut gemessen. Zunächst bekommen die Probanden Bilder gezeigt, mit denen Psychologen schon lange arbeiten und die positive oder negative Gefühle auslösen. Anschließend ärgern die Forscher sie ein wenig: die Probanden sollen mit einem eigens dafür entwickelten Software-Prototypen Navigationsaufgaben lösen. Manchmal unterstützt sie das System, in anderen Fällen behindert es die Lösung, indem etwas nicht funktioniert. Die Forscher versuchen so, Verbindungen zwischen den mutmaßlichen Emotionen und den gemessenen Hirnströmen zu finden.

Noch wissen Neurowissenschaftler nicht exakt, welche Muster der Hirnströme für welche Emotionen stehen. „Man weiß vor allem, dass Emotionen dort im Gehirn entstehen, wo wir mit unseren Geräten nicht hinkommen: ziemlich tief“, sagt Vukelic. Aber es gebe auch Auswirkungen auf den Kortex, die Gehirnrinde, an der gemessen werden kann. Dazu kommen dort allerdings Störsignale, die durch Muskelbewegungen wie Stirnrunzeln, Zähneknirschen oder Blinzeln entstehen.

Die Fraunhofer Forscher wollen in ihren Experimenten eine große Masse an Daten zu erzeugen, aus der hervorgeht, welche Muster und Hirnregionen für welche Emotionen stehen. Anschließend müssen stabile und schnelle Rechenvorschriften entwickelt werden, die Störsignale erkennen und herausfiltern – und das in Echtzeit. Wenn Schnittstellen künftig in Echtzeit Gefühle erkennen und sich anpassen sollen, ist es wenig realistisch, den Nutzer vor Arbeitsbeginn aufwendig zu verkabeln. Die Vision, dass sich Computer auf uns einstellen, ohne dass wir dafür etwas tun müssen, muss allerdings noch ein wenig reifen: 20 bis 30 Jahre, schätzt Vukelic, dauert es noch, bis eine entsprechende Anwendung reif für den Massenmarkt ist.

Neuro-Ergonomics und ihre Anwendungen

Biologie

Während sich die klassische Arbeitswissenschaft eher auf psychologische Methoden stützt, erforscht die Neuro-Arbeitswissenschaft auch biologische Faktoren. Dafür arbeiten Hirnforscher, Psychologen und Wissenschaftler aus dem Bereich Mensch-Maschine-Interaktion zusammen.

Schnittstellen

Eine wachsende Forschungsrichtung versucht, Geräte durch Hirnaktivitäten zu steuern. So wurden beispielsweise Roboter oder auch externe Gliedmaßen mit EEG-Signalen (Elektro-Enzephalogramm) bewegt.

Virtuell

Manche Forscher setzen hohe Erwartungen in die aufkommende Technik der Virtuellen Realität. Dabei werden Menschen mittels Computerbrillen in eine dreidimensionale Umgebung versetzt. So könnten Arbeitsplätze der Zukunft und die Reaktionen der Menschen darauf untersucht werden, ohne dass die neue Arbeitsumgebung real vorhanden sein muss.